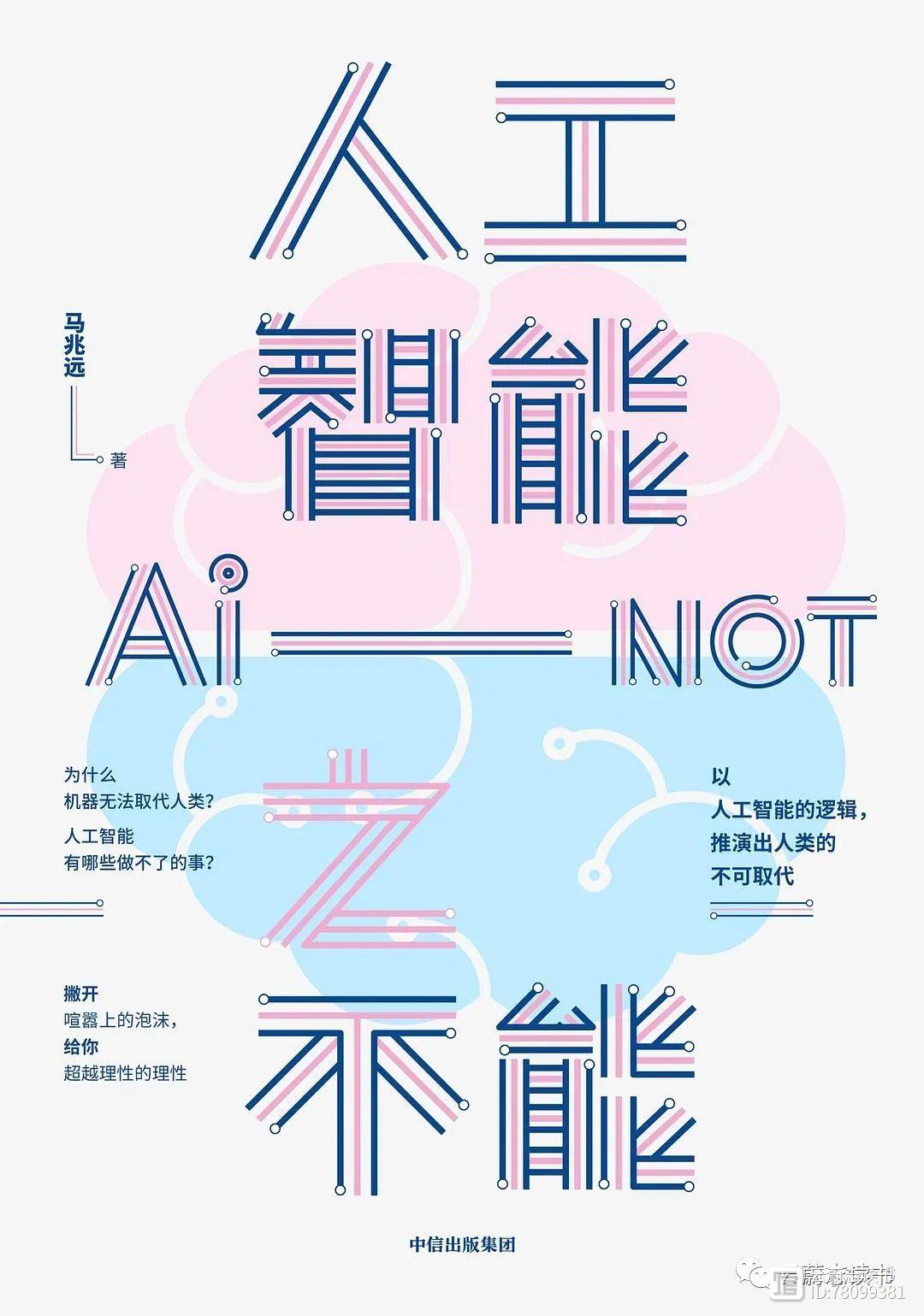

不完美的世界才完美——读马兆远著《人工智能之不能》

这本书名为《人工智能之不能》,其中的大部分篇幅却是在讲逻辑、数学、物理学,乃至哲学、宗教、治国理政。殊途同归,作者秉持跨界思维,别出心裁地从哥德尔不完备定理的角度,让读者了解到了人工智能的局限。

一、逻辑

直到今天,人工智能不管算法如何炫酷高深,都要基于推演逻辑的工具——图灵机来完成。因此,要了解人工智能做不了的事,就要先从了解逻辑和逻辑机开始。

(一)基本逻辑

逻辑的基本规则,至少包括以下内容:

1. 同一律(Law of Identity),即自始至终在唯一的确定的意义上使用同一个概念,不致于产生“混淆概念”和“转移话题”的逻辑问题。注意,同一律并不保证所讨论的对象本身的真实性,这只是命题保持一致,而与客观事实无关。

2. 矛盾律(Law of Contradiction),其要求是:在同一逻辑过程中不能同时有两个互相矛盾的概念或者陈述同时为真。

3. 排中律(Law of Excluded Middle),具体内容是:在同一逻辑过程中,两个互相否定的陈述不能都假,必有一真,反之亦然。

矛盾律和排中律是反证法的基础,二者都默认了二元论的假设。很多现实的对象是无法被二元化的,比如我们无法区分一个莫比乌斯环的正面和反面。

4. 充足理由律(Law of Sufficiency),其内容是:在同一逻辑过程中,一个陈述被确定为真,总有其充足理由。事物的存在,总有其道理,这个道理是充分的。

(二)逻辑谬误

接着,作者指出了一些常见的逻辑谬误。

1. 佛学中的逻辑谬误

在佛学经典里的逻辑谬误不胜枚举。如我是他,但他不是我(违反矛盾律);得即是失(违反矛盾律);既不是肯定也不是否定,二者都不对(违反排中律);勿言生,勿言无生(违反排中律)。

它们背后的禅理是语言无法达到的,也是不符合逻辑的。不符合逻辑可以推出任何结论,这也意味着推不出任何结论。

2. 语文的四大论证方法

在语文课上,举例论证、道理论证、比较论证和比喻论证是议论文写作的“四大论证方法”。可惜的是,这“四大论证方法”不是逻辑,甚至是谬误。

在逻辑论证中,我们更关心可以否定观点的反例。例论证中举出一两个例子来说明一个普遍的规律,是非逻辑的。以权威或者专家的观点来论证,都谈不上逻辑。类比推理和比喻论证往往只能提供某种“或然性”,但难以证明两类事物之间从假设到论证是严格一一对应的。

这四种所谓的论证方法,从逻辑上来说都是错误的。只能作为写作时的修辞手段,却不利于人的思考。

(三)自洽、完备性

自洽是指,在一个形式系统中,自身不能有矛盾。我们给出一个陈述,这个陈述能够被推导而证明是“真”,它的反面,虽然也是个有效陈述,不能也被证明是真的。

举例:一个人认为石头可以吃,然后他吃下了石头。当然这个陈述不必符合真实情况、道德标准等等,但前后不能出现矛盾。如果后面又认为石头不能吃,就不是自洽的了。

完备性是指,一个可做有效推演的形式系统总能对一个陈述给出符合推演规则的判断:或证实、或证伪。一个公设系统下任意的陈述可以通过逻辑推演被证明,或者它的反命题可以被证明,我们就说这个系统是完备的。

二、哥德尔的不完备定理

在基本逻辑之后,作者以极大的篇幅介绍了哥德尔的不完备定理。

(一)不完备定理

1. 哥德尔第一不完备定理

1931年,哥德尔(Gödel)发表了一篇影响深远的论文“On formally undecidablepropositions of Principia Mathematica and related systems I”。这篇论文中的定理VI就是“哥德尔不完备定理”,有时候也被叫做“哥德尔第一不完备定理”。

作者的整理为:在至少可以描述算术运算的自洽形式系统中,一定存在既不能被证实也不能被证伪的命题。

公理是无需证明而被认定为成立的命题。公理体系是指一组公理的集合。通过这些公理和基本的逻辑关系,可以推导出更多成立的命题,称为定理。公理体系是当今数学研究和科学研究的基础,数学研究成果就是(或者说在极大的程度上依赖于)一组公理体系的推演,而其它科学研究除了依赖公理体系进行推演外,还需要通过系统的实验来进行验证。

“哥德尔不完备定理”撼动了一切科学的研究基础——公理体系。

2. 哥德尔第二不完备定理

另外,“哥德尔不完备定理”还有一个推论,一般被叫做“哥德尔第二不完备定理”,它表明公理体系的一致性(相容的,无矛盾的,即希尔伯特说的compatibility,哥德尔说的consistency)不能在这个公理体系内被推导出来。也就是说,不仅完备性和一致性有矛盾,即使是一致性本身,也不能在公理体系内得到证明。作者的整理为:这样一个自洽系统无法证明本身是自洽的。

(二)数学的问题

数学家希望把数学搞成一个形式化系统,从逻辑出发来判定各种猜想,并得到一个确切的答案。哥德尔不完备定理表明,数学存在无穷多个有确切答案的问题,不能利用任何公设化程序找到它们的解。

1. 反证法

数学上大量使用了反证法。先假设一个命题正确,如果推出来一个跟已知定理矛盾的结论,假设就是错误的,这个命题不正确。但这种证明存在着悖论,比如我们试图证明:不存在对这句话的证明。

既然至少存在这样一个命题,我们无法证明不存在类似的命题,“理发师悖论”就是另一个。理发师说,只给不给自己剃头的人剃头。最开始理发师不给自己剃头,所以他应该给自己剃头。但他给自己剃头时,他又不是不给自己剃头的人了,他就不应该给自己剃头了。

2. 正面证明

除了反证法,还有正面证明通常采用的归纳法和演绎法。归纳法里只有自然归纳法是严格意义上的证明,而其他归纳法因为不能列出和验证所有的可能,所以不能构成严格的证明。

对于一般性公式的证明所用的自然归纳法,我们从有穷的条件集(“n=0”和“n=任意但确定的数”这两个条件),推导出适用于无穷个情况(所有可能的正整数)的结果。自然归纳法也需要假设:规律在无穷大的时候依然有效。但是,这个假设是有问题的,著名的“希尔伯特旅馆”就生动地解释了这一点。

我们要注意有限小的规律与无限大的规律未必一致,比如对正负一的循环序列进行求和:1 1–1 1……当这个序列有限长的时候,结果是确定的,但当这个序列无限长,结果就是未知的了。

对于演绎来说,证明陈述判断词的两端是严格等价的。比如,三角形内角和为180°,其中三角形的内角和跟180°本身是同一事物。这就无法避免地形成了自指,而逻辑证明中的自指会带来悖论。比如全能悖论 omnipotence paradox (上帝悖论) :是否有一个上帝或者全能的存在,可以创造出一个他自己也举不起的石块?

因此,作为真理的代表,数学的证明逻辑,似乎也出了大问题。

(三)哥德尔不完备定理的重要性

经过对以上数学问题的分析,作者总结出了哥德尔不完备定理所产生的重要影响:

第一,哥德尔不完备定理深刻地揭示了形式逻辑系统的内在局限性。

第二,数学是科学的基础,数学的不完备性说明科学结论也是不完备的。

第三,哥德尔不完备定理从科学的层次上揭示了人类认识的局限性。

还要强调的是,以上三个方面的影响可能不包括量子力学,虽然它也是人类创造的。量子力学本身可能是完备的,但不是经典意义上的自洽。这也解释了为什么迄今为止量子力学都是如此的令人费解。

三、人工智能之不能

(一)图灵机

1936年,图灵提出了著名的“图灵机”的设想。他将逻辑中的任意命题用一种通用的机器来表示和计算,并按照一定的规则推导出结论。

图灵机是由输入集合、输出集合、内部状态存储器、状态转移表四个部分组成。

如果要判别通用图灵机是否停机,而图灵证明了这样的图灵机并不存在,即图灵机停机问题是不可计算的。根据哥德尔第二不完备定理,不存在一个通用算法来判别哪些问题是自洽的。只要语句的不可判定无法证明,就证明不了程序是不是会停止。

(二)深度学习

哥德尔不完备定理通过图灵机延伸到用现代计算机所涉猎的所有问题,这当然也包括人工智能。这一轮人工智能浪潮以深度学习为主要驱动力。尽管有很多人认为神经网络是智能的,但它的工作机制与人类大脑有诸多的差别,以下是其中的三点。

首先,深度学习工具依赖大量的数据。在大多数情况下,每个神经网络都需要数千或数百万个样本来学习,深度学习存在严重的低效率问题。

其次,深度学习的算法逻辑不透明,更像一个黑盒子,输出的结果难以解释。在很多情况下,即使我们通过算法能够得到正确的答案,不透明所带来的不确定性也是不能接受的。

深度学习看似是一项先进的自动化科技,但也是需要人为调整上千万个自由变量,以便达到最优化的结果。因此,基于深度学习的人工智能实际上也成了劳动力密集型的工作,往往是冗长而枯燥的。

再次,目前从算法角度没有特别好的适应能力,或者说网络的迁移性并不理想。若要让一个神经网络识别一种新项目,只能从头开始训练它。网络设计得越复杂,准确度越高,它适应新数据库的能力就越差。

(三)真正的学习

人类通常只需要几个例子就能学习新概念,如果一个孩子要学习认识大象,并不需要看数以万计的大象照片。哪怕是和动物相比,深度学习也看不出有什么优势。

研究者做了一个有趣的实验。乌鸦想吃坚果,可没法砸开外壳。它把坚果抛到空中,可是果壳落地了还是没有碎。它发现,如果坚果落在路面上,会被车轧碎。但是,直接跑到车流中吃坚果又太危险,必须让车停下来。于是,它从行人控制交通灯,进一步认识到人、斑马线、交通灯、车流、马路之间复杂的因果关系。最后,乌鸦决定把坚果抛到斑马线上,再蹲在附近的一根电线上等待机会。等行人按下交通灯控制钮,车子都停了下来,它就可以从容不迫地飞下去吃地上的坚果肉了。

从乌鸦吃坚果的案例来看,它具有感知、认知、推理、学习和执行的综合能力。如果按照今天机器学习的思路,就需要设置假设、再分析信息,规划行动,其中涉及巨大的计算量,是不可能完成的任务。而乌鸦没法像深度学习那样进行几乎无限次的训练,它必须通过很少次数的尝试就要发现不能直接在公路上吃坚果。显然,乌鸦比今天的机器有更强的学习能力。

四、作者结论

(一)放心地去跟机器相处

既然深度学习如此局限,对人工智能快速发展的焦虑也就不必要了。

哥德尔证明的一个关键点,就是把“真”、“假”与“可证明”及“不可证明”区分开来了。“真命题未必可证明”,同时“不可证明的也未必就是假命题”。哥德尔不完备定理揭示了真实和可证之间那条无法逾越的鸿沟。这对人类来说是个好消息,我们不用太担心机器会自动发现真理。

它可以基于人类的真理假设,应用形式逻辑进行推演出新的命题,正如AlphaGo(阿尔法狗)尝试了很多人类所不知的下法那样。但依据哥德尔不完备定理,机器是无法创造棋局和游戏规则本身的。

作者从图灵机的定义出发,劝人们尽可安心。因为,所有可描述算法都可以由图灵机来完成,但所有不可描述的人类技能,比如感情、联想、直觉,我们也不懂如何用算法来描述。那么,我们也没必要担心机器,它们懂的东西也不会比我们更多。

作者推断,人工智能恐怕在未来三百年内还不会超越人脑,我们大可放心地去跟机器相处。

(二)不完美的世界

从哥德尔不完备定理可知,我们生活在一个不完美的世界里,可这也许正是个完美的世界。即使我们最终理解了理性的不完备,这也不是终极的知识阶段。

无论是数学还是其它科学,都需要不断的完善、扩充自身的公理体系(或者基本规律),只有这样才能不断认知更加深刻复杂的客观世界。

作者提出了一个务实主义的解决方案:不去追求极致的、绝对的真理,而是仅就已知的一分证据,推出相应的一分结论就好,不要多也不要少。

- 0000

- 0000